Eine zentrale Konfliktlinie im Diskurs über Künstliche Intelligenz liegt in der Präzision des Begriffs „Intelligenz“. Konfliktpotenzial hat dieser Begriff, weil noch nicht klar definiert ist, was Intelligenz meint und vor allem meinen soll. Im Teilbereich des maschinellen Lernens und hier wiederum im Bereich des deep learnings werden, verkürzt gesprochen, die Möglichkeiten ausgelotet, inwiefern Systeme und Programme selbst lernen und darauf aufbauend „handeln“ (oder auch „ausführen“) können. Empfohlen wird hier, sich bei der Weiterentwicklung solch sogenannter „starker KI“ vor allem an der menschlichen Kognition, sprich den Erkenntnissen aus den Kognitionswissenschaften, zu orientieren. Das dem Menschen eigene flexible Lernen, die Fähigkeit sich innerhalb kürzester Zeit und mit wenigen Daten/Referenzen neue Eigenschaften und neues Wissen anzueignen, wird als zentraler Bestandteil menschlicher Intelligenz bewertet. Ein Ziel aktueller Forschung ist es, eben diese Flexibilität der maschinellen „Intelligenz“ von Systemen, Programmen und Maschinen zu ermöglichen (Lenzen 2020)1. Die Streitpunkte im Diskurs um den Begriff „Intelligenz“ berühren, wie bereits angedeutet, die Frage was Intelligenz sein soll und was sie (noch) nicht sein soll. Was macht uns zum Menschen? Was macht uns besonders? Diese Fragen könnte man angesichts der im Diskurs diskutierten Deutungshoheiten vermuten.

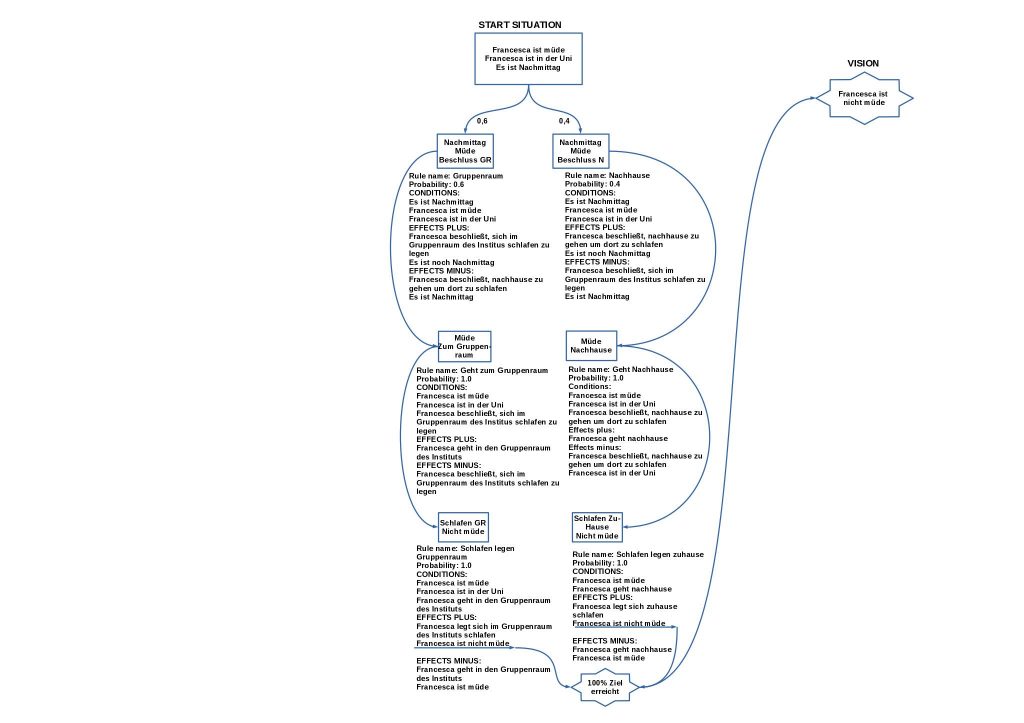

Die Maßstäbe unserer theoretischen Arbeit sind von dem Zweck der Software oksimo beeinflusst. Das Team um die Software hat im aktuellen Prozess bereits eine grundlegende Entscheidung getroffen: die sogenannte maschinelle „Intelligenz“ soll nicht in den kreativen, „schöpferischen“ Prozess des Menschen eingreifen, sondern lediglich die quantitativen Rechenleistungen übernehmen, die bei zunehmendem Datenaufkommen von Einzelpersonen oder auch Gruppen nicht mehr durchgeführt werden können. Beschäftigen wir uns im Rahmen unseres Projektes also mit dem Begriff der Intelligenz – der maschinellen, menschlichen und der kollektiven – so ist es angesichts unserer bereits getroffenen Entscheidung, die maschinelle „Intelligenz“ auf unterstützende Tätigkeiten reduzieren zu wollen, nicht von Interesse, den Diskurs darum was maschinelle Intelligenz alles sein und werden kann zu bedienen. Ich sehe unseren Ansatzpunkt vor allem im Diskurs darum, was die menschliche (kollektive) Intelligenz sein und leisten kann und welche Herausforderungen diese durch das Aufkommen digitaler vernetzter Technologien zu bewältigen hat. Mein Forschungsschwerpunkt wird dabei nicht auf biologischen Untersuchungen zum Thema Intelligenz liegen, sondern auf politikwissenschaftlicher und kulturanthropologischer Arbeit über Kollektivität. Es muss a) eine realistische Einschätzung des menschlichen Handlungssprektrums im digitalen Raum getroffen werden. Was und wie (ver)handelt der Mensch (gemeinsam) mithilfe vernetzter digitaler Technologien und in den „Räumen“, welche diese Technologien kreieren?

B) Es soll ein wissenschaftlicher Beitrag zu der Frage geleistet werden, inwiefern digitale Technologien dem Menschen beim gemeinsamen Handeln tatsächlich „dienen“ können. Bei diesem politisierten Satz wird oftmals vergessen, dass der Mensch selbst erst einmal entscheiden muss, wobei ihm eigentlich geholfen, oder „gedient“ werden soll. Deswegen wird sich c) abseits von Literatur über digitale Räume mit den Begriffen Kollektivität und Kollektives Handeln und ihren Bestimmungen kritisch auseinandergesetzt 2.

Ziel ist es, mit oksimo einen digitalen (Spiel)Raum zu schaffen, welcher zum einen mit Blick auf Herausforderungen und Einschränkungen durch aktuelle digitale Netzwerke und Technologien entwickelt wird und in der Benutzung und Architektur Unterschiede zu kommerziellen digitalen Plattformen aufweist. Zum anderen soll sich oksimo nicht schlichtweg vom kommerziellen Nutzen unterscheiden, sondern gleichzeitig angesichts des derzeitigen Forschungsstandes um Kollektive Intelligenz und Kollektivität ein Experimentierraum für kollektives, menschliches Handeln im digitalen Raum sein. Mensch-Maschine-Interaktionen können hinsichtlich vieler verschiedener Fragestellungen und verschiedenen Forschungsproblemen untersucht werden. Wir konzentrieren uns auf die Frage nach einer kollektiven Intelligenz.

1Lenzen, Manuela (2020): Künstliche Intelligenz. Fakten, Chancen, Risiken. München: C.H.Beck.

2Vgl. Léy, Pierre (1997): Collective Intelligence. Mankind´s Emerging World in Cyberspace.

Süß, Rahel Sophia (2015): Kollektive Handlungsfähigkeit. Gramsci – Holzkamp – Laclau/Mouffe. Wien/Berlin: Turia+Kant

Schmid, Hans Bernhard u. Schweikard, David P. (Hg.) (2009): Kollektive Intentionalität. Eine Debatte über die Grundlagen des Sozialen. Frankfurt a. M.: Suhrkamp.